Pamiętacie marzenia o robotach rodem z filmów sci-fi, które zajmą się domem, pomogą starszym i wykonają najcięższe prace? Zamiast tego otrzymywaliśmy maszyny do składania aut w fabrykach albo Roomby do odkurzania. Jednak od paru lat następuje przełom – inwestycje w humanoidy skoczyły do 6,1 miliarda dolarów w 2025 roku, a roboty uczą się teraz niczym dzieci: próbują, błądzą i wyciągają wnioski dzięki AI.

Reguły na papierze, czyli stara szkoła robotyki

Wyobraźcie sobie, że chcecie nauczyć robota składać koszulę. Zaczynacie od reguł: sprawdź materiał, by nie pękł, zlokalizuj kołnierzyk, chwyć lewy rękaw, złóż o dokładnie 5 centymetrów. A co, jeśli koszula jest obrócona? Trzeba dodać regułę obrotu. Podwinięty rękaw? Kolejna poprawka. Szybko powstają setki takich instrukcji, ale to działało – tak wyglądał klasyczny sposób programowania robotów w fabrykach samochodowych.

Ironia losu: marzyliśmy o uniwersalnych maszynach, a budowaliśmy wyspecjalizowane ramiona. Do 2015 roku to podejście dominowało, ponieważ próby naśladowania ludzkiego ciała kończyły się fiaskiem. Eksplozja reguł blokowała skalowalność, ale zapewniała przewidywalność.

Symulacje i metoda prób i błędów: przełom około 2015 roku

Wtedy nadeszła zmiana: zamiast kodować każdą ewentualność, zaczęto budować symulacje ramion i ubrań w środowisku komputerowym. Robot otrzymuje nagrodę za sukces i karę za porażkę – w ten sposób testuje miliony wariantów. To ten sam mechanizm, który pozwolił AI wygrywać w gry takie jak Go czy szachy.

Problem? Symulacja to nie rzeczywistość – kolory są inne, a guma w palcach bardziej rozciągliwa. Rozwiązaniem okazała się randomizacja dziedziny (domain randomization), czyli celowe różnicowanie warunków w symulacjach: zmiana oświetlenia, tarcia czy sztywności materiałów. Dzięki temu Dactyl z OpenAI nauczył się układać kostkę Rubika. Miliony iteracji w symulacji stały się kluczem do adaptacji w realnym świecie.

Jibo: robot społeczny przed erą LLM

Cynthia Breazeal z MIT w 2014 roku zaprezentowała Jibo – robota domowego przypominającego lampę, pozbawionego ramion i nóg. W ramach crowdfundingu zebrano 3,7 miliona dolarów, a 4800 osób złożyło zamówienia przedpremierowe za 749 dolarów. Robot tańczył dla dzieci i przedstawiał się domownikom, ale jego możliwości były ograniczone.

Projekt upadł w 2019 roku, ponieważ interakcja językowa była sztywna niczym wczesna Siri czy Alexa – oparta na skryptach i powtarzalnych odpowiedziach. Jibo przegrał z asystentami głosowymi, którym brakowało głębi. Dziś modele LLM zapewniają płynne rozmowy, choć niosą nowe ryzyka – zabawki potrafią opowiadać o niebezpiecznych przedmiotach. 4800 zamówień przedpremierowych to było za mało, by przetrwać.

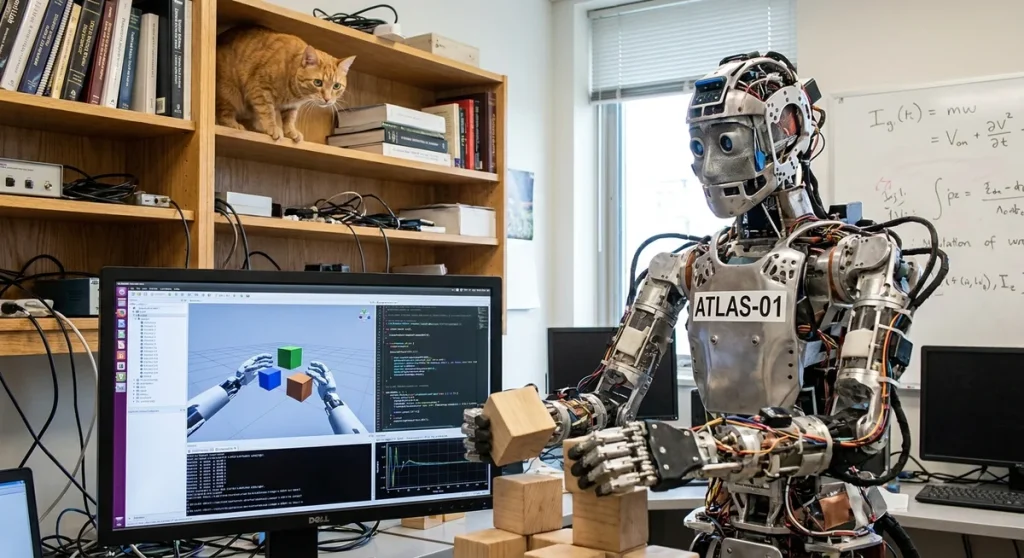

Dactyl i RT-2: od chwytaków do modeli transformatorowych

W 2018 roku OpenAI trenowało system Dactyl w symulacji na kostkach z literami – zadaniem było obrócenie czerwonej ścianki z literą O do góry. Udało się ułożyć kostkę Rubika z 60-procentową skutecznością, ale w 2021 roku dział ten zamknięto. Z kolei Google DeepMind pod wodzą Kanishki Rao zarejestrowało 700 zadań, takich jak przekładanie chipsów czy słoików. Model RT-1 osiągnął 97% skuteczności w znanych zadaniach i 76% w nowych.

RT-2 z 2023 roku wzbogacono o dane z internetu, co pozwoliło mu zrozumieć polecenia typu „postaw Colę obok Taylor Swift”. Gemini Robotics w 2025 roku łączy te umiejętności z modelami językowymi. Rao twierdzi: „To odblokowało zupełnie nowe możliwości”. 97% sukcesu RT-1 pokazuje potęgę odpowiedniej skali danych.

Praktyka: Covariant i Digit w magazynach

Firma Covariant, założona przez byłych inżynierów OpenAI (Petera Chena i Pietera Abbeela), buduje model RFM-1 dla magazynów Crate & Barrel. Model zachowuje się jak współpracownik: można mu kazać przenieść rakietki, a on przewiduje błędy i pyta o odpowiednie ssawki. Choć Amazon licencjonuje tę technologię, demo z 2024 roku pokazało ograniczenia: robot pomylił obiekty z powodu braku danych o „cofaniu się”.

Z kolei Digit od Agility Robotics to humanoid bez głowy, który przenosi pojemniki dla takich gigantów jak Amazon, Toyota czy GXO. Wykorzystuje symulacje i model Gemini, ale jego udźwig to zaledwie 35 funtów, a bateria stanowi znaczne obciążenie. To wciąż faza testów, a nie rewolucji. Chen przyznaje wprost: bez danych system nie zadziała. 35 funtów udźwigu to obecne realia technologii.