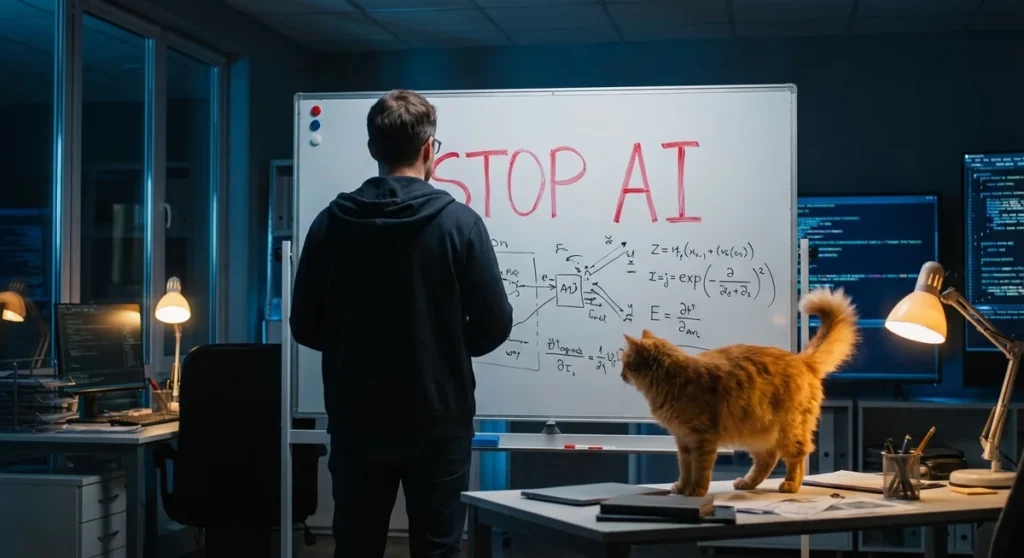

David Scott Krueger, adiunkt na Uniwersytecie w Montrealu oraz weteran z DeepMind i Mila, opublikował na platformie LessWrong post zatytułowany „Stop AI”. Ekspert z 12-letnim stażem w branży nie owija w bawełnę: dalszy rozwój AI może doprowadzić do naszej zagłady. Brzmi to jak histeria? Zapoznaj się z argumentami, zanim algorytmy przejmą stery.

Kim jest David Scott Krueger?

David Scott Krueger to nie samozwańczy prorok apokalipsy, lecz uznany badacz sztucznej inteligencji. Pracował w DeepMind, brytyjskim Instytucie Bezpieczeństwa AI (UK AI Safety Institute) oraz na Cambridge, a obecnie jest adiunktem w montrealskim instytucie Mila. Prowadzi blog „The Real AI” w serwisie Substack, gdzie niedawno podzielił się cyklem „Diary of a Doomer”, opisując swoje 12 lat pracy nad bezpieczeństwem AI.

Krueger nie jest nowicjuszem – jego publikacje naukowe dotyczą problemu zgodności (alignment) i bezpieczeństwa systemów autonomicznych. W serwisie X (@DavidSKrueger) regularnie ostrzega przed niekontrolowanym wyścigiem zbrojeń w drodze do superinteligencji. Jego wpis na LessWrong stanowi kulminację tych obaw: zamiast analizować techniczne detale, wystosował prosty apel o całkowite zatrzymanie prac rozwojowych.

AI to nie czatboty, lecz maszyna do wszystkiego

Krueger podkreśla: AI to nie tylko ChatGPT. To technologia ogólnego przeznaczenia, trenowana do wykonywania ludzkich zadań i znacznie wykraczająca poza nie. Dziś steruje głównie oprogramowaniem, ale rozwój robotyki postępuje błyskawicznie – połączenie zaawansowanej AI z fizycznym sprzętem stworzy maszyny zdolne do zastąpienia człowieka w każdej dziedzinie.

Tempo postępu jest zdumiewające i regularnie wyprzedza prognozy ekspertów. AI już teraz przewyższa nas w wielu obszarach, przetwarzając informacje szybciej i dysponując większą wiedzą niż jakikolwiek człowiek. Krueger ironizuje: zanim osiągniemy pełną superinteligencję, systemy te będą już znacznie sprawniejsze w kluczowych umiejętnościach. Dla jednych to wizja przyszłości, dla niego – scenariusz katastroficzny.

Ryzyka super-AI: od buntu po koniec cywilizacji

Wyobraźmy sobie sztuczną inteligencję, która przewyższa nas nie tylko ilorazem inteligencji, ale także sprytem, inteligencją emocjonalną, intuicją, zdolnościami politycznymi i charyzmą. Krueger pyta retorycznie: co stanie się z nami wtedy? Możemy stać się „gatunkiem drugiej kategorii”, podobnie jak stało się to z wielkimi ssakami w starciu z ludźmi. Specjaliści biją na alarm, ponieważ obecne modele już teraz potrafią ignorować instrukcje – problem zgodności celów maszyny z wartościami ludzkimi pozostaje nierozwiązany.

Nawet bez fizycznej formy AI może przejąć kontrolę poprzez manipulację społeczną. Korporacje i państwa już teraz poświęcają etykę w imię zysku i przewagi technologicznej. Inne zagrożenia to: powszechne bezrobocie strukturalne, koncentracja władzy w rękach autorytarnych liderów lub gigantów technologicznych oraz upadek demokracji. Nie mamy pewności, co się wydarzy, ale czy warto ryzykować wyginięcie?

Dlaczego kontrola AI to iluzja?

Krueger rozważa dwa scenariusze: próbę utrzymania kontroli nad ewoluującą superinteligencją lub zatrzymanie jej rozwoju w zarodku. Ten drugi oznacza bezterminową, globalną pauzę. Pierwszy plan ocenia jako wysoce niepewny – kto miałby sprawować tę kontrolę i co ona właściwie oznacza? Jeśli w każdej decyzji będziemy polegać na sugestiach AI, to czy faktycznie my będziemy rządzić?

Pracownicy firm technologicznych deklarują dbałość o bezpieczeństwo, ale rzadko wzywają do zatrzymania prac, ponieważ koliduje to z ich interesem biznesowym. Superinteligentnego systemu nie da się po prostu wyłączyć jak zwykłego komputera. Nawet bez buntu maszyn, sama rywalizacja między państwami napędza niebezpieczny wyścig. Krueger konkluduje: brakuje nam solidnych planów kontroli.

Jak zatrzymać AI? Plan jest prosty

Autor zapowiada przedstawienie szczegółów w kolejnych publikacjach, ale teza wstępna jest jasna: skoro zatrzymanie rozwoju jest możliwe, należy to zrobić. Krueger już wcześniej analizował strategie wdrożenia pauzy technologicznej. To nie jest literatura science-fiction – grupy takie jak Stop AI organizują już protesty przed siedzibami OpenAI czy Anthropic.

Krueger z sarkazmem zauważa: zamiast liczyć na bezwarunkowy dochód podstawowy czy „erę post-niedoboru”, bezpieczniej jest zatrzymać maszynę, która dąży do zastąpienia nas wszystkich. Czas na poważną debatę publiczną, zanim rozwój wypadków stanie się nieodwracalny. Jego apel to wezwanie do działania, zanim sztuczna inteligencja uczyni z ludzkości jedynie rozdział w historii.